Microsoft 365 Copilot: Technisch erklärt

Microsoft 365 Copilot ist ein RAG-System aus LLM, Microsoft Graph und Semantic Index. So funktioniert die Architektur, für IT-Verantwortliche erklärt.

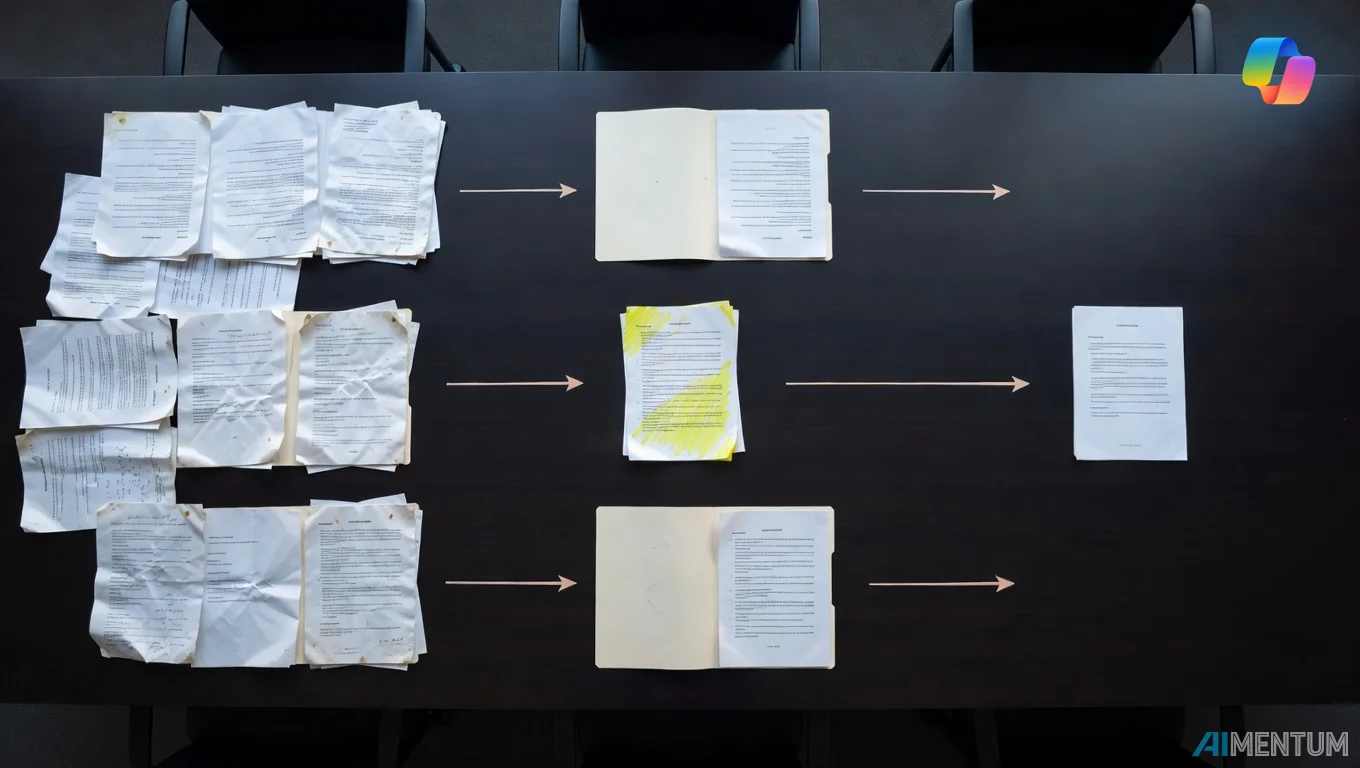

Microsoft 365 Copilot sieht auf der Oberfläche aus wie ein Chatbot. Technisch ist es das nicht. Microsoft 365 Copilot ist kein Chatbot mit Internetzugang, sondern ein RAG-System, das bei jeder Anfrage automatisch Daten aus dem eigenen Microsoft-365-TenantGlossarEin Tenant (deutsch: Mandant) ist die isolierte Microsoft-365-Umgebung eines Unternehmens. Alle Nutzer, Daten, Lizenzen und Konfigurationen eines Kunden sind in einem eigenen Tenant getrennt von anderen Organisationen. abruft und als Kontext in das Sprachmodell einspeist. Retrieval-Augmented Generation (RAGGlossarRAG ist eine Technik, bei der ein KI-Modell vor dem Antworten gezielt relevante Dokumente aus einer Wissensdatenbank abruft. So entstehen aktuelle, quellenbasierte Antworten statt ausgedachter Informationen.) ist eine Technik, bei der ein Sprachmodell vor dem Antworten automatisch relevante Dokumente aus einer Wissensdatenbank abruft und als Kontext in den Prompt einfügt. Unter der Haube orchestriert Copilot dabei drei Schichten: ein Sprachmodell auf Azure-Basis, eine API-Schicht über Ihre gesamte Microsoft-365-Umgebung und einen Vektorindex Ihrer Unternehmensdaten.

Dieser Artikel erklärt, wie Microsoft 365 Copilot technisch funktioniert: von der Architektur über die Prompt-Verarbeitung bis zum Datenschutz.

Laut Microsoft Work Trend Index 2024 nutzen bereits 75 % der Wissensarbeiter KI am Arbeitsplatz, der Großteil davon mit eigenen, nicht unternehmensgesteuerten Tools (Microsoft Work Trend Index 2024). Die Frage ist also nicht mehr, ob KI im Unternehmen ankommt. Die Frage ist, ob IT-Verantwortliche die Architektur dahinter verstehen, bevor sie ausrollen.

Dieser Artikel erklärt, wie Copilot intern arbeitet. Kein Marketing, keine Buzzword-Liste. Nur die Technik.

Die drei Bausteine

Copilot besteht aus drei unabhängigen Komponenten, die bei jeder Anfrage zusammenarbeiten (Microsoft Docs Architektur 2026).

Azure OpenAI LLM

Das Fundament ist ein großes Sprachmodell (LLM). Standardmäßig läuft ein GPT-basiertes Modell auf Azure-OpenAI-Infrastruktur, nicht auf der öffentlichen OpenAI-API. Administratoren können im Microsoft-365-Admin-Center zusätzlich Drittmodelle aktivieren: Anthropic Claude ist seit Januar 2026 für die meisten kommerziellen Tenants standardmäßig aktiviert. Für US-Tenants steht außerdem xAI als Option zur Verfügung. Welches Modell tatsächlich läuft, ist für den Endnutzer nicht sichtbar.

Das LLMGlossarEin Large Language Model ist ein KI-System, das auf Basis riesiger Textmengen trainiert wurde und menschliche Sprache versteht, generiert und verarbeitet. Die technische Grundlage für Chatbots, Copilot und KI-Agenten. ist zuständig für Sprachverständnis und Textgenerierung. Es kennt Ihre Unternehmensdaten nicht aus dem Training, sondern erhält sie als Kontext in den Prompt injiziert.

Microsoft Graph

Microsoft Graph ist die API-Schicht über alle Microsoft-365-Dienste. Copilot ruft über Graph auf Mails, SharePoint-Dokumente, Teams-Chats, OneDrive-Dateien und Kalendereinträge zu.

Entscheidend: Graph arbeitet ausschließlich im Rahmen der bestehenden RBAC-Berechtigungen des Nutzers. Copilot kann nichts sehen, was der Nutzer selbst nicht sehen darf. Eine Copilot-Anfrage überschreibt keine Zugriffsrechte.

Semantic Index

Der Semantic Index ist ein Vektorindex, der als Ergänzung zur klassischen Keyword-Suche funktioniert. Statt nach exakten Worttreffern zu suchen, berechnet er semantische Ähnlichkeiten zwischen Anfrage und Dokumentinhalten (Microsoft Docs Semantic Index 2025).

Der Index ermöglicht es, Dokumente zu finden, in denen der gesuchte Begriff nicht wörtlich vorkommt. Eine Suche nach “Kündigungsfristen Lieferant” findet auch ein Dokument, das “Vertragsauflösung Zulieferer” enthält, wenn der semantische Kontext stimmt.

Wie Microsoft 365 Copilot einen Prompt verarbeitet

Zwischen Ihrer Eingabe und der Antwort laufen fünf Schritte ab. Das dauert in der Praxis zwei bis fünf Sekunden (Microsoft Docs Architektur 2026).

Schritt 1: Nutzerprompt aus der M365-App

Sie tippen eine Anfrage in Word, Teams, Outlook oder Copilot Chat. Die App sendet den Prompt an den Copilot-Orchestrator.

Schritt 2: Grounding (Pre-Processing)

Grounding bezeichnet den Prozess, bei dem Copilot einen Nutzerprompt vor der LLM-Verarbeitung mit kontextrelevanten Daten aus Microsoft Graph und dem Semantic Index anreichert. Bevor der Prompt das LLM erreicht, reichert der Orchestrator ihn mit Kontext an. Dazu ruft er gleichzeitig Microsoft Graph und den Semantic Index ab. Er sucht nach relevanten Mails, Dokumenten, Meeting-Protokollen und Kalendereinträgen, die zur Anfrage passen.

Die Analogie: Copilot liest schnell die relevanten Akten, bevor es antwortet. Ein Mensch würde dasselbe tun, nur langsamer.

Die gefundenen Inhalte werden als Kontext-Snippets in den Prompt eingefügt. Der Prompt, der das LLM erreicht, ist damit deutlich länger und informativer als Ihre ursprüngliche Eingabe.

Schritt 3: Angereicherter Prompt an Azure OpenAI LLM

Der vollständig angereicherte Prompt verlässt den M365-Service-Perimeter und erreicht die Azure-OpenAI-Infrastruktur. Beide sind Microsoft-Dienste, aber technisch getrennte Komponenten.

Schritt 4: Antwort-Generierung

Das LLM generiert eine Antwort auf Basis des angereicherten Prompts. Es nutzt dabei seine Sprachfähigkeiten, nicht sein Vortraining als Informationsquelle. Die Fakten kommen aus Ihren Dokumenten, die Formulierung liefert das Modell.

Schritt 5: Post-Processing

Die generierte Antwort durchläuft einen zweiten Grounding-Call: Copilot prüft, welche Inhalte als Quellen belegt werden können, und fügt Zitierungslinks ein. Responsible-AI-Checks filtern schädliche oder unangemessene Inhalte. Erst dann erscheint die Antwort in Ihrer App (Zenity Labs 2024).

Konkretes Beispiel: Sie fragen in Outlook: “Fasse mir die letzten E-Mails mit Müller GmbH zusammen.”

Der Orchestrator ruft über Graph alle E-Mails mit dem Absender- und Empfängerfeld “Müller GmbH” der letzten 30 Tage ab. Er extrahiert Betreffzeilen, Datumsangaben und Schlüsselpassagen. Diese Snippets werden in den Prompt eingefügt. Das LLM generiert eine strukturierte Zusammenfassung mit Datumsangaben und Kernaussagen. Zitierungslinks zeigen auf die Original-Mails.

Der Semantic Index

Der Semantic Index ist die wichtigste Erweiterung gegenüber klassischer Microsoft Search. Er wandelt Dokumente in mathematische Vektoren um, sogenannte Embeddings. Diese Vektoren repräsentieren den semantischen Gehalt eines Textes als Koordinaten im mehrdimensionalen Raum (Microsoft Docs Semantic Index 2025).

Ähnliche Texte liegen im Vektorraum nah beieinander. Das ermöglicht Ähnlichkeitssuche: Copilot findet Dokumente, die inhaltlich passen, auch wenn die exakten Suchbegriffe nicht vorkommen.

Was wird indexiert?

Der Semantic Index besteht aus zwei Ebenen:

Tenant-Level-Index: SharePoint-Dateien im gesamten Tenant werden indexiert. Unterstützte Formate: DOCX, PPTX, PDF bis 512 MB. Neue Dokumente werden täglich nachindexiert. Änderungen an bestehenden Dokumenten lösen eine sofortige Nachindexierung aus.

User-Level-Index: Persönliche Daten jedes Nutzers werden separat indexiert. Dazu gehören die eigene Mailbox in Exchange Online, eigene OneDrive-Dateien und Inhalte, in denen der Nutzer direkt erwähnt wird.

Was nicht indexiert werden kann

Der Semantic Index kann nicht deaktiviert werden. Er ist ein integraler Bestandteil von Microsoft Search. Einzelne SharePoint-Sites lassen sich jedoch explizit aus dem Index ausschließen. Das ist relevant für Standorte mit besonders sensiblen Inhalten, die nicht über Copilot zugänglich sein sollen.

Datenschutz und Tenant-Isolation

Die Datenschutz-Architektur von Copilot ist eine der häufigsten Fragen beim Rollout. Die relevanten Fakten (Microsoft Docs Privacy 2026):

Service-Boundary: Kundendaten verlassen nie die Microsoft-365-Service-Boundary des eigenen Tenants. Die Datenverarbeitung findet innerhalb des mandantenspezifischen Perimeters statt.

Kein Caching: Azure OpenAI cached keine Copilot-Prompts. Nach der Antwortgenerierung werden Prompts und Antworten nicht gespeichert.

Kein Training: Microsoft verwendet Prompts und Antworten nicht für das Training von KI-Modellen. Das gilt für alle M365-Copilot-Interaktionen.

EU Data BoundaryGlossarDie EU Data Boundary ist Microsofts Zusage, Kundendaten und personenbezogene Daten europäischer Microsoft-365-, Power-Platform-, Dynamics-365- und Azure-Kunden ausschließlich innerhalb der EU und EFTA zu speichern und zu verarbeiten.: Für EU-Kunden verbleibt Traffic innerhalb der EU. Microsoft hat diese Regelung zum 1. März 2024 in Kraft gesetzt. Rechenzentren in der EU verarbeiten die Daten, ohne dass sie in die USA übertragen werden.

Sensitivity Labels: Copilot respektiert Microsoft-Purview-Sensitivity-Labels vollständig. Ein Dokument mit dem Label “Vertraulich” wird im Copilot-Kontext entsprechend behandelt. Der Inhalt wird nicht in Antworten eingebettet, wenn der Nutzer keinen Zugriff darauf hat.

Compliance: M365 Copilot ist zertifiziert nach DSGVO, ISO 27001, HIPAA und ISO 42001.

Wenn Sie Copilot DSGVO-konform ausrollen und Sensitivity Labels konfigurieren wollen, begleitet die KI Automatisierung diesen Prozess Schritt für Schritt.

Wichtiger Hinweis zu Drittmodellen: Ab Januar 2026 ist Anthropic als Subprozessor in den M365-Copilot-Diensten gelistet. Anthropic-Modelle (Claude-Familie) sind nicht im EU Data Boundary enthalten. Wenn ein Administrator Anthropic-basierte Modelle im Copilot-Admin-Center aktiviert, verlassen EU-Kundendaten bei der Verarbeitung potenziell die EU. Die Einstellung ist standardmäßig deaktiviert und muss explizit aktiviert werden.

Warum Copilot trotzdem halluzinieren kann

Halluzinationen sind keine Fehler im Sinne eines Bugs, sondern eine strukturelle Eigenschaft von LLMs. Drei Ursachen sind bei Copilot relevant:

1. Retrieval-Fehler

Der Semantic Index findet nicht immer das relevanteste Dokument. Wenn ein Dokument schlecht strukturiert ist, wenig Text enthält oder in einem Format vorliegt, das nicht optimal indexiert wird, liefert das Retrieval unvollständige Ergebnisse. Das LLM füllt die entstandenen Lücken mit Wissen aus dem Vortraining, das für Ihren spezifischen Kontext falsch sein kann.

2. Kontext-Overflow

Das LLM hat ein begrenztes Kontextfenster. Bei umfangreichen Abfragen, die viele Dokumente und lange E-Mail-Threads einbeziehen, muss Copilot priorisieren und Snippets kürzen. Informationen, die aus dem Kontext fallen, sind für das Modell nicht mehr sichtbar. Das kann zu unvollständigen oder verkürzten Antworten führen.

3. Strukturelle LLM-Eigenschaft

LLMs sind Wahrscheinlichkeitsmodelle, keine Fakten-Lookup-Systeme. Sie berechnen für jedes Token die wahrscheinlichste Fortsetzung. Das führt zu flüssigem, überzeugend klingendem Text, auch dann, wenn die zugrundeliegenden Fakten fehlen oder falsch sind.

Copilot begegnet diesem Problem mit Zitierungslinks und Responsible-AI-Checks. Beide Mechanismen reduzieren das Halluzinationsrisiko, eliminieren es aber nicht. Für unternehmenskritische Entscheidungen gilt: Copilot-Ausgaben immer gegen die zitierten Quelldokumente prüfen. Copilot ist ein Assistent, kein Auditor.

Copilot in Teams-Meetings

Eine der meistgenutzten Copilot-Funktionen ist die Meeting-Unterstützung in Microsoft Teams. Copilot kann während eines laufenden Meetings Zusammenfassungen liefern, Fragen über den bisherigen Gesprächsverlauf beantworten und nach dem Meeting automatisch Protokoll, Aktionspunkte und offene Fragen generieren.

Technisch funktioniert das über die Meeting-Transkription: Teams wandelt Sprache in Text um. Copilot erhält diesen Transkript-Text als Grounding-Kontext und kann darüber Anfragen wie “Was haben wir bisher zur Budgetfrage beschlossen?” direkt beantworten.

Wichtig zu verstehen: Ohne aktivierte Transkription hat Copilot keinen Zugriff auf den Meeting-Inhalt. Die Funktion muss in der Teams-Admin-Konsole explizit aktiviert werden. Und: Die Transkription startet, sobald das Meeting beginnt. Inhalte, die vor der Aktivierung gesprochen wurden, sind für Copilot nicht verfügbar.

Copilot vs. ChatGPT: Der technische Unterschied

| Merkmal | M365 Copilot | ChatGPT Enterprise |

|---|---|---|

| RAG-Integration | Systemseitig, automatisch | Explizit konfigurierbar |

| Datenquellen nativ | Mail, SharePoint, Teams, OneDrive, Kalender | Externe Konnektoren nötig |

| M365-App-Integration | Nativ | Nicht nativ |

| EU Data Boundary | Ja (EU-Kunden, seit 1. März 2024) | Regionale Optionen |

| Modell | Azure OpenAI GPT + optional Anthropic Claude, xAI (US) | OpenAI GPT-Familie |

Der entscheidende Unterschied liegt nicht im Modell, sondern in der Architektur. ChatGPT ohne Enterprise-Konfiguration hat kein RAG. Es antwortet aus dem Vortraining, ohne Zugriff auf Ihre Unternehmensdaten. Microsoft 365 Copilot hat RAG als Kerneigenschaft: Jede Antwort basiert auf einem automatischen Retrieval-Schritt aus Ihrem Tenant.

ChatGPT Enterprise erlaubt RAG-Konfigurationen, aber diese müssen explizit eingerichtet werden. Datenquellen werden über externe Konnektoren angebunden. Die M365-App-Integration ist nicht nativ vorhanden, sondern erfordert zusätzliche Entwicklung. Für Unternehmen, die bereits in Microsoft 365 investiert haben, ist der Integrationsaufwand mit Copilot erheblich geringer.

Technische Voraussetzungen

Pflichtvoraussetzungen

Für den Betrieb von Microsoft 365 Copilot sind folgende Voraussetzungen erforderlich (Microsoft Docs Anforderungen 2026):

Lizenz: Als Basislizenz ist M365 Business Standard, M365 Business Premium, Microsoft 365 E3 oder E5 erforderlich. Copilot selbst ist ein separates Add-on mit eigenem Lizenzpreis. Office 2019 oder Office LTSC-Lizenzen reichen nicht aus.

Exchange Online: Die Mailbox des Nutzers muss in Exchange Online liegen. Hybrid-Konfigurationen mit On-Premises-Postfächern werden nicht unterstützt. Reine On-Premises-Exchange-Installationen schließen Copilot aus.

Microsoft Entra IDGlossarMicrosoft Entra ID (ehemals Azure Active Directory) ist der zentrale Identitäts- und Zugriffsverwaltungsdienst in Microsoft 365. Er steuert Benutzer, Gruppen, Berechtigungen und Anmelderichtlinien für alle Cloud-Dienste eines Tenants.: Der Nutzer-Account muss ein Microsoft-Entra-ID-Account sein. Lokale Active-Directory-Accounts ohne Entra-ID-Synchronisierung funktionieren nicht.

Browser: Moderner Browser empfohlen. Microsoft Edge bietet die tiefste Integration. Chrome und Firefox werden unterstützt. Internet Explorer wird nicht unterstützt.

Netzwerk: Spezifische Microsoft-365-Domains dürfen nicht gesperrt sein. WebSocket-Verbindungen (WSS-Protokoll) müssen erlaubt sein, da Copilot für die Echtzeit-Kommunikation auf WebSockets angewiesen ist. Proxy-Konfigurationen, die WSS blockieren, verhindern die Nutzung.

Empfohlene Maßnahmen vor dem Rollout

Diese Punkte sind keine technischen Pflichtvoraussetzungen, aber entscheidend für einen reibungslosen Rollout:

SharePoint-Governance: Vor dem Copilot-Rollout eine Oversharing-Analyse durchführen. Copilot macht sichtbar, was bereits sichtbar war, aber bisher durch mangelnde Suchbarkeit verborgen blieb. Dokumente, die zu breit geteilt sind, werden durch Copilot für mehr Nutzer zugänglich. Eine Berechtigungsprüfung vor dem Rollout adressiert dieses Risiko direkt.

Microsoft Purview Sensitivity Labels: Sensitivity Labels ermöglichen es, Dokumente nach Vertraulichkeitsgrad zu klassifizieren. Copilot respektiert diese Labels automatisch. Wer Labels vor dem Rollout einführt, hat granulare Kontrolle darüber, welche Inhalte Copilot in Antworten einbinden darf.

Meeting-Transkription: Copilot kann nach einem Teams-Meeting eine Zusammenfassung, Aktionspunkte und offene Fragen generieren. Diese Funktion setzt voraus, dass die Meeting-Transkription aktiviert ist. Ohne aktivierte Transkription hat Copilot keinen Zugriff auf den Meeting-Inhalt. Die Aktivierung erfordert eine bewusste Entscheidung in der Teams-Admin-Konsole und im besten Fall eine interne Kommunikation an die Mitarbeiter.

Ob Ihre Umgebung bereit ist, prüfen wir in der KI Beratung: einer strukturierten Readiness-Analyse in einem halben Tag. Für eine kompakte Übersicht der Checkpunkte eignet sich außerdem die Copilot Readiness Checkliste.